主成分分析の2種類の定式化

次元空間に

個のベクトル

があるとする。

平均は原点に一致するとする。つまり、と仮定する。

各ベクトルのエントリは、と書くことにする。

さて、これらの個のベクトルの集合に対して、

ある単位ベクトルをとって、下記の2種類のいずれかの条件を満たすようにする。

2種類の条件とは、分散の最大化と、残差平方和の最小化である。

分散の最大化で考える分散とは、個のベクトル

を

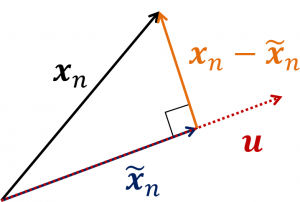

へ正射影したベクトル

の長さの分散である。

残差平方和の最小化で考える残差とは、

正射影したベクトルと元のベクトル

との差ベクトルの長さである。

2種類の条件のどちらを考えても、全く同じが答えとして求まる、

というのが、この記事で言いたいことである。

1.分散を最大化する

ベクトルの上に

個のベクトルそれぞれを正射影する。

ということは、各について、

かつ

を満たす

を求めればよい。

を解くと、

だから、

を得る。

は単位ベクトルだったから、

。

よって、である。

つまり、の上に、各ベクトル

を正射影すると、

というベクトルを得る。

これら正射影ベクトルの長さの分散

を最大化する

は単位ベクトルなので、

を満たさなければならない。

そこで、ラグランジュの未定乗数法を使い、

を最大化する。

そのためには、

偏微分を計算する前に、の各項を細かく書き下す。

さらに細かく書き下す。

よって、

を得る。

を解けばよいことが分かる。

左辺は、次のように書き直せる。

よく見ると、

そこで、の分散共分散行列

を使って、さらに書き直す。

なお、

行列の第

行を

と書くことにすると、

これはさらに、下のように書き直せる。

すべてについて結果をまとめて書くと

となる。つまり、

ここで、最大化したかった分散を思い出す。

先ほどの方程式

この分散の値はどのように書き直せるだろうか。

この分散を、細かく書き下してみると

となる。その一方、

つまり

を得ていた。左辺が分散の式と似ている。そこで、この両辺に

両辺の

よく見ると、左辺は分散

右辺は

つまり、

という関係式を得た。

同じことは、分散の式を次のように変形しても導ける。

そして

よって、

ところで、が満たす方程式

は、線形代数で言うところの、行列

これを満たす固有ベクトル

しかし、欲しかったのは、分散を最大化するである。

が分散

に等しくなったのだから、

・・・ということは、最大の固有値に対応する固有ベクトルが、求めたかったであることになる。

2.残差平方和を最小化する

の上に、各ベクトル

を正射影すると、

というベクトルを得ることはもう分かっている。

よって、差ベクトルはである。

この長さの平方和を最小化するようなを求めたい。つまり、

を最小化する

足されているを書き直す。

書き直すとき、

が何であれ、

の部分は一定のままである。

ということは、解こうとしている最小化問題は

の最小化と等価で、これは、先ほど最大化しようとしていた分散に

つまり、全く同じ問題を解いていることになる。

なので、答えも同じ。

というか、ピタゴラスの定理で斜辺の長さが一定の状況に相当するので、

残りの2辺のうち一方の長さの2乗を大きくすることは、

他方の長さの2乗を小さくすることと等価になる。

(おわり)